СОДЕРЖАНИЕ

Как проверить фильтры Яндекса и Google онлайн

Какие бывают фильтры поисковых систем?

Фильтры Google - 5, - 30, - 950 12

Дополнительные результаты (Supplementary results)

Слишком много ссылок и слишком много страниц

Фильтр за медленную загрузку страниц

Фильтр за отсутствие оптимизации под мобильный трафик

2. Фильтр за переоптимизацию «Баден-Баден»

3. Фильтр за накрутку поведенческих факторов

6. Санкции за взрослый контент

7. Пессимизация за отсутствие адаптации

Чек-лист по фильтрам поисковых систем

Пришло время затронуть одну из самых болезненных тем продвижения. Основная причина этой самой «болезненности» заключается в том, что поисковые системы постоянно вводят все новые и новые алгоритмы, а в качестве бонуса – еще и совершенствуют старые.

Один из самых нашумевших за последнее время примеров – алгоритм Яндекса «Баден-Баден» (или, как его еще в шутку называют – Banned-Banned). Есть аналогичный фильтр и у Google. Однако, есть одна небольшая (точнее – очень большая) проблема. Дело в том, что в Яндекс.Вебмастере и в Google Serach Console Вы не всегда будете получать уведомления о наложении того или иного фильтра. Следовательно, нужно крайне тщательно следить как минимум за позициями и за трафиком, т.к. именно они в самую первую очередь и страдают. И вот почему.

Вот Вам краткий список признаков, по которым Ваш сайт, вероятно, попал под фильтр:

- ощутимое падение трафика, привлекаемого из поисковых систем;

- резкая просадка позиций (как всего сайта, так и каких-то отдельных страниц в частности);

- выпадение сайта (или каких-то отдельных его страниц) в дополнительный индекс;

- полное выпадение сайта из ТОП-100;

- свежие материалы не индексируются;

- низкие позиции по брендовым запросам.

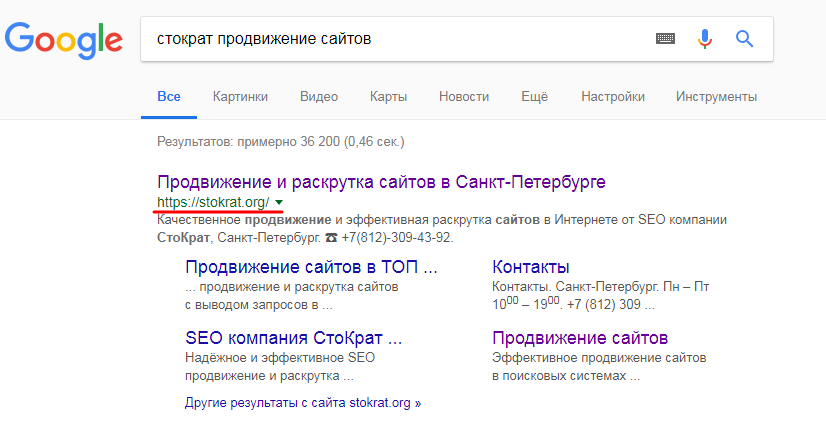

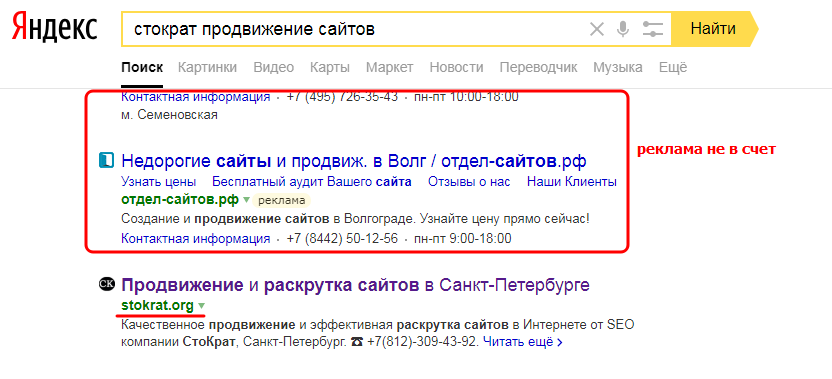

И вот на последнем пункте остановимся чуть-чуть подробнее. Если ввести в Google или Яндекс запрос «стократ продвижение сайтов», то можно увидеть, что в обоих случаях, если не считать рекламную выдачу, сайт stokrat.org будет на первой позиции.

Разумеется, мы упомянули об этом вовсе не для того, чтобы сказать «смотрите, какие мы молодцы». Мы это сказали для того, чтоб и Вы периодически делали такие проверки. И если Ваш сайт по таким запросам будет выводиться, скажем, где-то на 30-40-х позициях, то это однозначно тревожный знак.

Как проверить фильтры Яндекса и Google онлайн

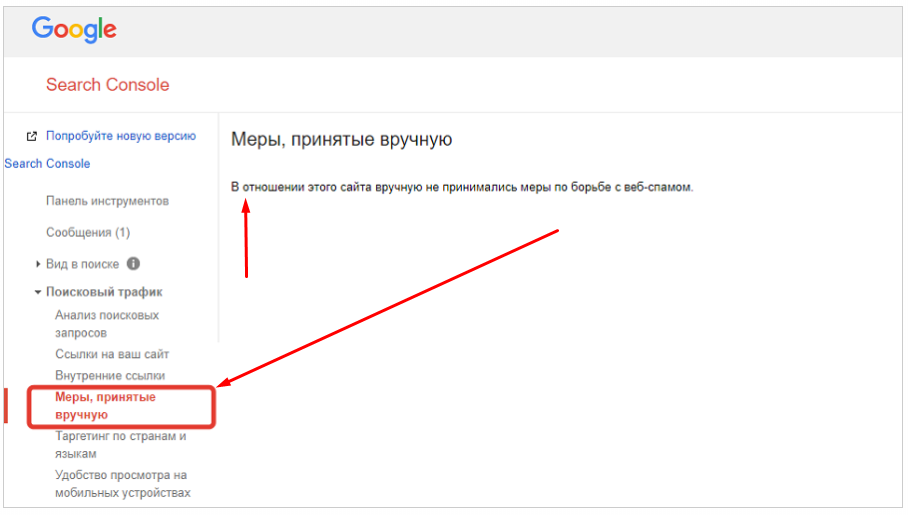

Итак, теперь переходим к самому неприятному – диагностика. Самый простой способ диагностики – штатные средства поисковых систем, т.е. Google Search Console и Яндекс.Вебмастер.

В Google Search Console это делается в меню Поисковый трафик – Меры, принятые вручную. Если на сайт были наложены какие-то ручные (именно РУЧНЫЕ) фильтры, то будет соответствующее уведомление. В данном случае уведомлений нет, следовательно, вручную никаких фильтров на сайт наложено не было.

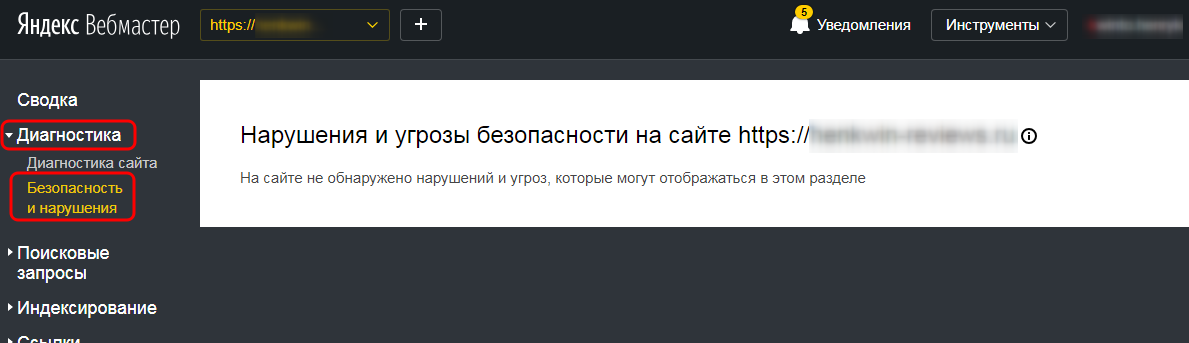

В Яндекс.Вебмастере же необходимо заходить в Диагностика – Безопасность и нарушения. Если список пуст, значит все нормально. Если же что-то не так – Яндекс обязательно об этом подскажет.

Плюс к этому, не забывайте просматривать уведомления.

Если в обоих случаях кабинеты «молчат», а подозрения на наложение каких-либо автоматических фильтров все-таки есть, значит пора переходить к анализу непосредственно самого сайта.

И начнем с первичного анализа в тех же самых вебмастер-кабинетах, т.к. там можно проверить количество страниц, находящихся в индексе. Если их количество вдруг резко уменьшилось – нужно разбираться в причинах. Например, если количество проиндексированных страниц уменьшилось из-за склеивания дублей (причем как через 301 редирект, так и через rel=canonical) и закрытия от индексирования технических страниц, то это абсолютно нормально и причин для паники нет. А вот если это произошло спонтанно – значит сайт болен и требует лечения.

Еще раз – в Яндекс.Вебмастере первым делом необходимо лезть в «Диагностику», а вот в Google Search Console имеет смысл просмотреть 4 раздела на предмет «чего-то подозрительного» - «Поисковый трафик», «Вид в поиске», «Сканирование», «Индекс Google». Но на что именно обращать внимание?

Во-первых, проблемы с адаптивностью сайта под экраны мобильных устройств. Сообщения о проблемах с адаптивностью появляются в Search Console в разделе «Поисковый трафик – Удобство просмотра на мобильных» и в Яндекс.Вебмастере «Диагностике сайта». Как правило, при таких проблемах страдает именно мобильный трафик, десктопный остается без изменений.

Во-вторых, в разделах «Сканирование – Проблемы безопасности» (Search Console) и «Диагностика – Безопасность и нарушения» (Яндекс.Вебмастер) может появиться информация о наличии вредоносного кода на Вашем сайте. В этом случае необходимо вылечить сайт от вирусов, а также позаботиться о более высоком уровне безопасности Вашего сайта.

В-третьих, спам-ссылки. Т.е. заходим Google Search Console, затем идем в раздел «Поисковый трафик – Ссылки на ваш сайт» и просматриваем список ссылок, ведущих с других сайтов на Ваш. О том, насколько избыточное количество неестественных ссылок вредит продвижению, будет рассказано далее, а пока просто запомните, что чем их меньше – тем лучше. Такую же проверку необходимо провести в Яндекс.Вебмастере – для этого там есть раздел «Ссылки – Внешние ссылки».

Основные 4 момента мы затронули. Однако, регулярно просматривайте список уведомлений по Вашему сайту, т.к. могут прийти уведомления и о других нарушениях, из-за которых сайт если и не попадает под санкции, то как минимум ранжируется хуже.

Ну а теперь перейдем к рассмотрению некоторых сервисов онлайн-диагностики сайта. И вот тут мы хотели бы сразу же прояснить один важнейший момент. Дело в том, что информация об алгоритмах держится Яндексом и Гуглом в строжайшем секрете и сторонним разработчикам не сообщается. Именно поэтому сервисы, о которых сейчас пойдет речь, по определению не могут предоставить точную информацию. Вероятную – да, точную – нет.

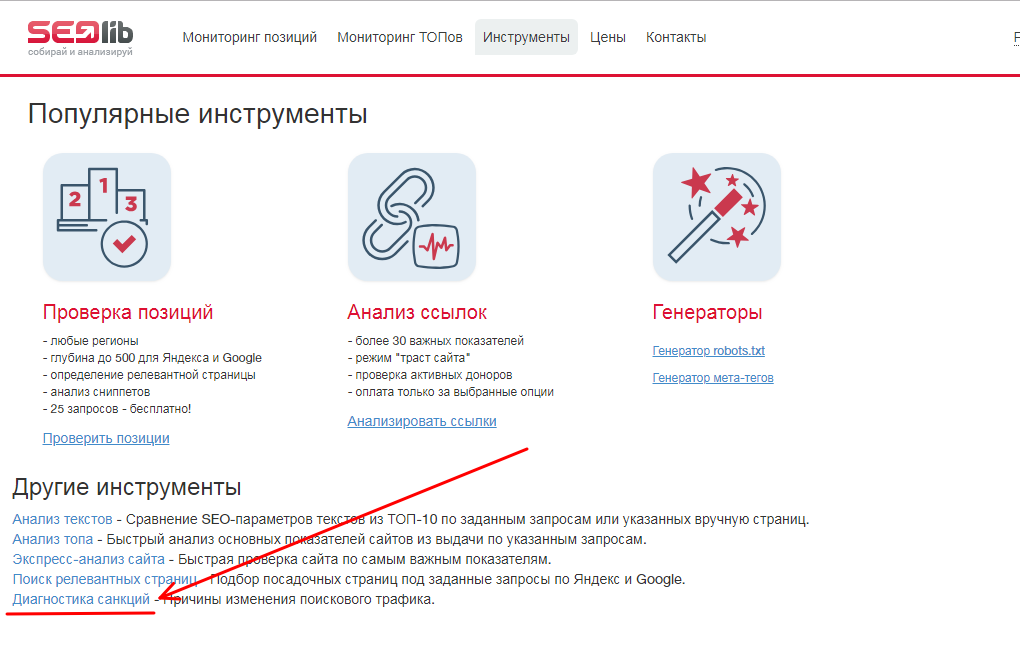

Диагностика санкций SEOLib

Данный сервис многофункционален. С его помощью можно провести оценочный анализ на попадание под санкции, мониторить позиции, а также анализировать качество ссылочной массы (вполне может пригодиться, если есть подозрения на ссылочный фильтр).

Важный момент – для анализа сайта на санкции потребуются данные от Яндекс.Метрики и Google Analytics.

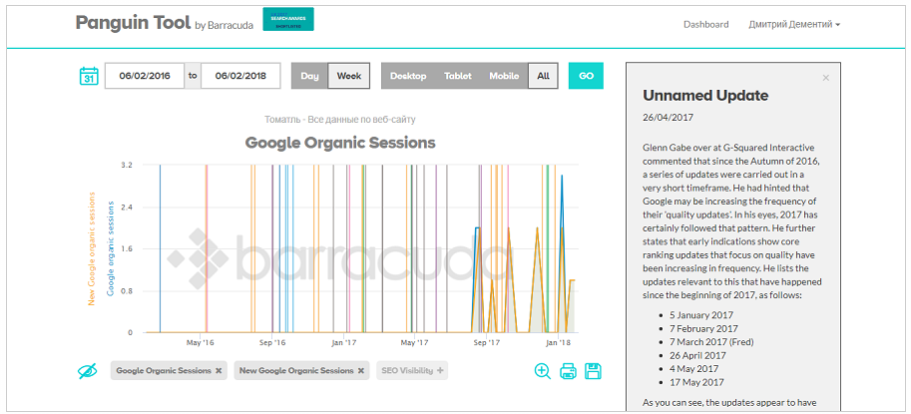

Panguin SEO Tool by Barracuda

С помощью данного инструмента можно отслеживать влияние изменений работы алгоритмов Google на посещаемость Вашего сайта.

История обновлений алгоритма Google от MOZ

Сервис аналогичен предыдущему.

Проверка фильтров Google от Fruition

В бесплатном режиме позволяет отслеживать влияние фильтров Google максимум для двух сайтов.

SEMRush Sensor

Еще один сервис, отслеживающий влияние апдейтов Google на Ваш сайт, + позволяет отслеживать позиции в поисковой выдаче.

Какие бывают фильтры поисковых систем?

Ну а теперь давайте займемся классификацией фильтров.

По поисковым системам.

Тут всё предельно просто: сколько поисковых систем – столько и пунктов у данной классификации. Однако, такие поисковые системы, как Bing, Yahoo и т.п., нам не интересны, поскольку в России они крайне мало востребованы. Поэтому в России принято делить на «фильтры Яндекса» и «фильтры Google».

По способу применения.

Ранее мы уже упоминали, что санкции могут быть наложены вручную. Следовательно, раз есть ручные – значит есть и автоматические (точнее – алгоритмические). Различие между ними в том, что алгоритмические накладываются роботами в автоматическом режиме, а ручные – сотрудниками поисковой системы. Наложение ручных санкций происходит следующим образом:

- робот анализирует сайт;

- если робот находит что-то подозрительное, но не в состоянии однозначно трактовать свои подозрения, сайт передается на анализ живым специалистам;

- сотрудник поисковой системы проводит ручной анализ, делает выводы и уже сам принимает решение накладывать санкции или нет.

По причинам санкций.

Здесь можно выделить достаточно большое количество причин:

- черные методы продвижения, направленные на обман поисковой системы;

- текстовый спам;

- накрутка ссылок;

- накрутка поведенческих факторов;

- скрытый текст (находящийся за пределами экрана, цвет текста совпадает с цветом фона, либо размер шрифта равен нулю);

- отсутствие адаптации под мобильные устройства (адаптивная верстка, мобильная версия сайта, Google AMP, Яндекс.Турбо-страницы);

- слишком долгая загрузка страниц сайта;

- бесполезный контент;

- нерабочий функционал (либо работающий, но неправильно);

- недоработанный дизайн;

- недостаточное юзабилити;

- дублирующийся контент;

- мошенничество

и т.д., список можно продолжать очень долго.

И еще одно важное замечание. Фильтры – это часть алгоритма ранжирования сайтов, т.е. это далеко не всегда плохо. Фильтры были придуманы для того, чтоб выдавать пользователю наиболее релевантный контент. Т.е. если Вы живете в Саранске, то при запросе «заказать пиццу» в выдаче (ну или хотя бы в ТОП-10) не должно быть сайтов московских пиццерий, верно? Другой пример – запрос «пластиковые окна цена». А вот 3 реальных примера, по которым разные организации пытались оптимизироваться под данный запрос:

1) размещен онлайн-калькулятор;

2) на страницу добавлен текст «Цены на пластиковые окна начинаются от 3628 руб за кв.м. Замер и доставка - бесплатно.»;

3) на страницу добавлен текст «Сколько стоит квадратный метр стеклопакета пластикового окна? Цена остекления в компании [название организации] вполне демократичная».

И сейчас для каждого из Вас становится очевидно, что по данному запросу первые 2 решения являются самыми правильными, а третье – это просто бесполезный кусок текста. Поэтому в первых двух случаях фильтры сыграют только на пользу сайтам, а в третьем случае – во вред, причем обоснованно. Именно поэтому каждый маркетолог должен «как отче наш» помнить два важнейших тезиса:

- возможности попадания под санкции необходимо отсекать еще на этапах планирования маркетинговой стратегии;

- если сайт все-таки оказался под санкциями – значит стратегию нужно менять, а не бороться с последствиями неправильно выбранных способов продвижения.

А вот теперь переходим к конкретике.

Санкции и фильтры Google

Google. Так исторически сложилось, что это самая крупная поисковая система в мире. И так уж истерически сложилось, что именно по этой причине Google является самым крупным борцом с манипуляциями и манипуляторами. Мэтт Каттс, работающий сейчас в правительственных структурах Штатов, в свое время внёс огромный вклад в противодействие поисковому спаму, а потому снится накрутчикам в самых страшных снах. На протяжении многих лет Google успешно борется с недобросовестными вебмастерами в США. В Рунете данная борьба идет с переменным успехом, однако, бОльшая часть этого «переменного успеха» все-таки числится за Google.

Алгоритм Google Panda

Алгоритм «Панда» является частью поискового алгоритма Google. Панда отвечает за качество сайтов в целом, а также за качество контента в частности. Как Вы уже догадались, если качество сайта/контента Панду не устраивает, значит хороших позиций Вам не видать, следовательно, не видать и трафика.

По каким же критериям Google Panda оценивает сайт?

Качество контента.

О том, по каким критериям оценивается качество контента, мы подробно рассказывать не будем, т.к. это тема не просто для отдельной статьи, а для целой серии статей. Плюс к этому, качество контента оценивается не только Пандой. Однако, если «на пальцах», то контент должен реально содержать ответы на те вопросы, которые могут возникнуть у читателя, когда он вводит тот или иной запрос. Вспомните пример с ценовым поисковым запросом. Также информацию до читателя можно доносить с помощью списков, картинок, фотографий, графиков, таблиц, видеоматериалов, GIF-анимаций, и т.д.

Плюс к этому, качество контента оценивается по еще одному косвенному признаку – поведенческие факторы. Кстати, как давно Вы их анализировали?

Дублированный контент.

В данном случае речь не о том, что контент дублируется дословно, а о том, что контент дублируется по смыслу. Т.е. если взять 2 страницы, одна из которых затачивалась под «заказать окна ПВХ», а вторая – под «заказать пластиковые окна» (т.е. по смыслу это один и тот же запрос), а контент на обеих страницах идентичен по смыслу – ждите санкций от Панды.

При этом Панда НЕ запрещает затачивать разные страницы под одни и те же запросы. В Рунете полно примеров, когда в ТОП-10 по одному и тому же запросу располагается 2-3 страницы одного и того же сайта. Т.е. под эти запросы можно заточить 2-3 страницы. Например, на одной странице можно разместить текст плана «у нас можно заказать пластиковые окна», а на другой – «на что обратить внимание при заказе пластиковых окон», т.е. дать рекомендации, чтобы заказчику не впарили чего-то лишнего, чтобы заказчик знал, к чему может привести экономия, и т.д. При таком подходе Панда Вас не только не накажет, но, возможно, еще и поощрит, т.к. информация в обеих статьях по-своему ценна.

Ворованный контент.

Разумеется, это наказанием будет далеко не «мгновенная карма». Просто исходники при прочих равных ранжируются выше.

Да, мы не спорим, в Рунете полно кейсов, когда исходные тексты ранжировались хуже, чем ворованные. Однако, с этих же кейсов рассмотрены отличия исходных текстов от ворованных.

Пример 1 – юзабилити. Если у сайта ворованные тексты, но гораздо более приятный дизайн, более высокая скорость загрузки и т.д., то в этом случае ворованный текст будет ранжироваться выше, чем первоисточник.

Пример 2 – портянки. Если Вы составляете лонгрид по на тему «ТОП-10 самых [чего-то там]», то Вы вполне можете взять 10 разных статей, объединить их в одну портянку и опубликовать на сайте. В этом случае поисковой системе Google будет проще показать в ТОПе одну Вашу страницу, чем 10 первоисточников.

ВАЖНО! В обоих случаях имеет смысл оставлять ссылки на первоисточник. Причем ссылки должны быть dofollow.

Отношение владельца сайта к своим посетителям.

Тут все просто. Чем лучше владелец сайта относится к своим подписчикам – тем лучше. А вот мини-список того, в чём вообще должно выражаться это отношение:

- приятный и удобный дизайн;

- функционал, удовлетворяющий требованиям Вашей аудитории;

- отсутствие избыточного количества навязчивых всплывающих окон;

- читабельный контент.

Насчет последнего пункта проясним важный момент.

Представьте себе ситуацию – Вы зашли на сайт и увидели следующее:

- сначала шапка, закрывающая собой половину экрана;

- затем рекламные блоки, перекрывающие оставшуюся половину экрана;

- ниже еще какая-нибудь ересь;

- и только потом контент.

За такое Панда обязательно Вас накажет. Чем выше располагается контент – тем лучше. Разумеется, есть и исключения. Например, в карточках товара гораздо правильнее сначала размещать характеристики/цены/модификации/цвета и т.д., и только после этого разместить текст-описание, поскольку потенциальному покупателю удобнее изучать карточку именно в такой последовательности: сначала характеристики, и только потом читать описание.

Как определить, Google Panda Ваш сайт пессимизировала? Очень просто:

- резкая просадка позиций в Google;

- как следствие, резкая просадка трафика из того же Google;

- замедленное индексирование страниц.

Имейте в виду, что просадки могут быть как на каких-то конкретных страницах, так и на всём сайте целиком.

Как вывести ресурс из-под фильтра Google Panda

Чем быстрее Вы на это среагируете – тем лучше. Во-первых, тем быстрее Панда увидит, что Вы «встали на путь исправления». Во-вторых, тем быстрее Вы выведете сайт из-под санкций.

Особое внимание следует уделить:

1) Проведению полного аудита сайта – проверьте работоспособность имеющегося функционала, погуляйте по конкурентам и прикиньте, какие еще фишки можно «украсть», убедитесь в том, что вёрстка сайта умеет адаптировать дизайн под различные размеры окна, чтобы сайт грузился как можно быстрее.

2) Сделайте так, чтобы дублирующегося контента на сайте не было: если тексты разные, но схожи по смыслу, перепишите их таким образом, чтоб они были разными по смыслу, ну а если речь идет о «технических» дублях, то их необходимо «склеить» с помощью настройки редиректа с кодом ответа 301, либо с помощью rel=”canonical”.

3) Закройте от индексирования «технические» страницы, которые продвигать вообще не требуется (например, страница входа в админ-панель, страницы категорий и/или рубрик, тегов и т.д.) – сделать это можно через robots.txt, а также через мета-теги <meta name="robots" content="noindex"> или <meta name="robots" content="none">. Если Ваш сайт базируется на движке WordPress, то можно решить эту проблему различными SEO-плагинами.

4) Избавьтесь от некачественного контента (либо просто удалите его, либо замените на качественный). Т.е. контент должен быть реально полезным и информативным. Если на страницах нет контента – обязательно его добавьте.

5) Не забывайте регулярно публиковать свежий контент.

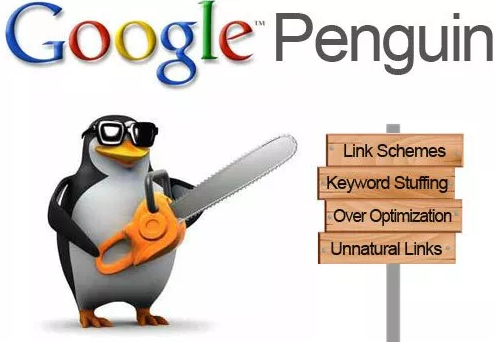

Google Penguin

«Пингвин» – данный фильтр стал частью основного алгоритма ранжирования Google. Задача «Пингвина» - помогать основному поисковому алгоритму бороться с манипулятивным линк-билдингом. В эту борьбу входит сведение на «нет» влияния:

- купленных ссылок;

- спамных ссылок, оставляемых где-то на форумах, в комментариях, либо в «гостевых» постах;

- ссылок с избыточным использованием неестественных SEO-анкоров;

- невидимых ссылок (например, если ссылка закрепляется за пробелом, либо за каким-то знаком препинания).

Т.е. фильтр не наказывает за выше перечисленное – он просто этого не учитывает.

Если в общих чертах, то признаки воздействия Пингвина на Ваш сайт схожи с Пандой, за исключением некоторых моментов:

- Пингвин в большинстве случаев накладывается вместе с Пандой, Панда же примерно в половине случаев накладывается без Пингвина;

- при наложении санкций со стороны Пингвина в Google Search Console обычно появляется сообщение о ручном наложении санкций;

- Пингвин может сопровождаться не просто выпадением страниц во вторичный индекс, но и полным деиндексированием страниц.

Как отличить «Пингвин» от «Панды»?

Встречный вопрос – а зачем? Оба этих алгоритма еще в 2016 году стали частью основного алгоритма ранжирования. Диагностируются санкции в обоих случаях одинаково. Плюс к этому, постарайтесь самостоятельно ответить на вопрос: «а что же я делаю с сайтом?». Если Вы постите рерайт-тексты и закупаете ссылки – не удивляйтесь, если санкции будут наложены обоими фильтрами. Если просто закупаете ссылки – Пингвин, если размещаете рерайт-тексты – Панда. Т.е. это как раз тот случай, когда «мы с Томарой ходим парой», или «беда не приходит одна». Поэтому и отличать санкции Пингвина от санкций Панды нет никакого смысла.

Как вывести ресурс из-под фильтра Google Penguin

Гораздо правильнее сначала спросить «что делать, чтобы НЕ ПОПАСТЬ под санкции Пингвина?». А вот и ответы:

- тщательно следить за качеством ссылочной массы;

- публиковать только качественный контент, настолько качественный, чтобы авторитетные ресурсы САМИ им делились со своими подписчиками.

А теперь о том, как вывести сайт из-под санкций Пингвина:

- проанализировать ссылочную массу на качество;

- если есть возможность – удалить все неестественные (т.е. спамерские) ссылки;

- если некоторые ссылки удалить не получается – сообщить об этом поисковой системе (вот форма - https://www.google.com/webmasters/tools/disavow-links-main), тогда влияние этих ссылок, возможно, учитываться перестанет. Почему «возможно»? Потому что ссылки, отправляемые через форму отклонения обратных ссылок, будут анализироваться специалистами вручную.

Песочница

Существование данных фильтров официально не подтверждено. Тем не менее, мы считаем, что они есть. А направлены они на то, чтобы ограничить посещаемость сайта, который был недавно создан. Т.е. сайт на несколько месяцев попадает под фильтр сразу же после создания. Самое время заняться допиливанием юзабилити, дизайна, а также наполнением сайта контентом. Спустя некоторое время санкции будут сняты и Ваш сайт будет хорошо ранжироваться. Т.е. данные санкции являются временной мерой, а значит будут сняты в любом случае.

Фильтры Google -5, -30, -950

Существование данных минус-фильтров Google официально не подтверждает. Но мы-то с Вами знаем, что они все-таки существуют, верно? А как иначе объяснить, что сайт, находясь в ТОП-1, на основании чего-то теряет сразу же 5 позиций? Ни 6, ни 8, ни 3, а именно 5. Как объяснить, что сайт, находясь в ТОП-10, на основании чего-то теряет сразу же 30 позиций? Ни 29, ни 25, ни 33, а именно 30? И то же самое касается «минус 950».

Данные санкции накладываются в качестве предупреждения, мол, «топить мы сайт пока что не будем, но, если будут еще манипуляции – накажем». А накажут на следующее:

- использование дорвеев (страниц, заточенных на выведение в ТОП по ряду поисковых запросов, но затем пользователей перенаправляют на другой сайт);

- использование клоакинга (когда для пользователя отображается один контент, а для поискового робота – другой);

- ссылочный спам на различных нетематических блогах и форумах;

- применение переадресаций с помощью JavaScript.

Т.е. официально этих минус-фильтров как бы и не существует, «но это не точно». Однако, выше перечисленные предупредительные санкции требуют немедленного вмешательства, ибо не исключено, что предупредительное наказание спровоцировано происками конкурентов.

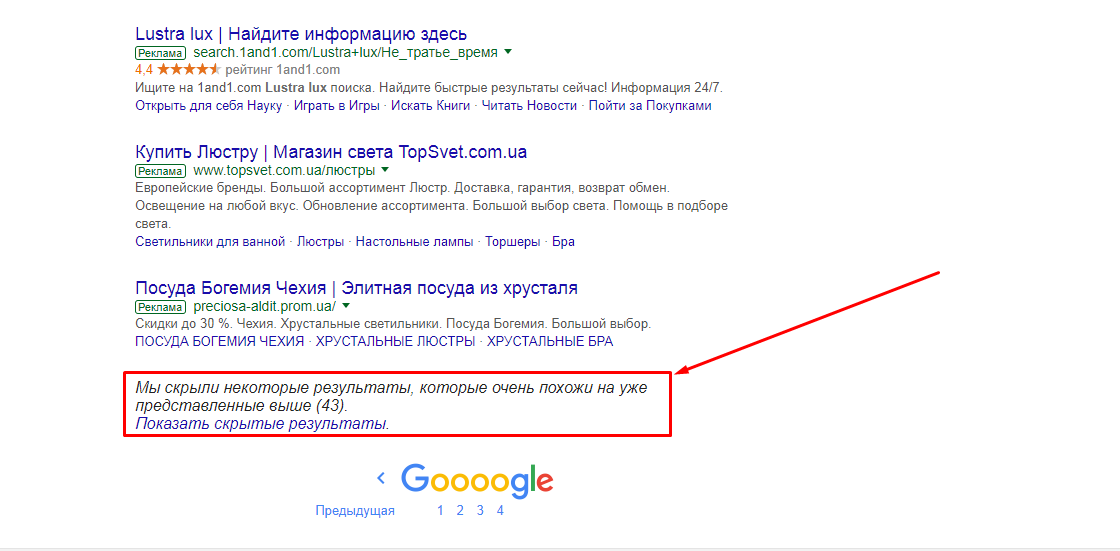

Дополнительные результаты (Supplementary results)

Для начала пару слов о том, чем основной индекс отличается от дополнительного. Дополнительный индекс НЕ участвует в поисковой выдаче. Тем не менее, иногда Google пишет вот такое уведомление:

Эти 43 страницы как раз и взяты из дополнительного индекса.

И сразу же ответим на вопрос – а как же выяснить, сколько страниц в основном индексе, а сколько – в дополнительном? Очень просто.

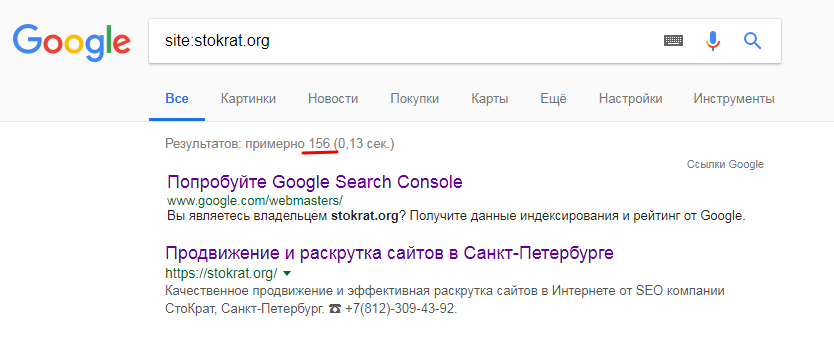

Шаг 1. Вбиваем в поисковую строку Google команду site:[адрес Вашего домена] (например, site:stokrat.org) и получаете полный список проиндексированных страниц, а также их количество. Т.е. тут количество.

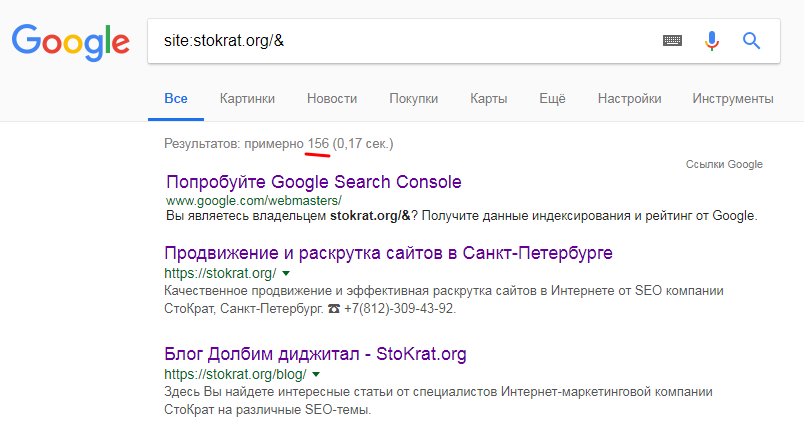

Шаг 2. К этому поисковому запросу без пробелов дописываем /& и снова смотрим результат.

Итак, в первом шаге мы выяснили, что в обоих индексах у нас 156 страниц. Во втором шаге мы выяснили, что в основном индексе 156 страниц. Осталось путем простых вычислений выяснить, сколько же у нас страниц находится в дополнительном индексе. Для этого из числа, полученного в первом шаге, вычитаем число, полученное во втором шаге. Разность этих чисел – это как раз количество страниц из дополнительного индекса. В нашем случае 156(шаг1)-156(шаг2)=0, т.е. в дополнительном индексе страниц нет.

Ну а теперь пара слов о том, какие именно страницы попадают в дополнительный индекс:

- страницы молодых сайтов (т.к. у них еще нет репутации как таковой);

- страницы, контент которых поисковые системы считают недостаточно качественным;

- страницы, содержащие технические ошибки.

Как защититься от фильтра «Дополнительные результаты»

Тут все достаточно просто:

- не манипулируйте поисковой выдачей;

- сделайте контент на страницах более ценным;

- закройте от индексирования дубли и «технические» страницы;

- исправьте все технические проблемы;

- доработайте юзабилити сайта.

Бывало даже так, что в дополнительный индекс выпадали страницы сайтов с неудобным меню и внутренней навигацией.

Социтирование

Если коротко, то вот несколько тезисов данного фильтра:

- ссылочный вес передается не только от донора к реципиенту, но и от реципиента к донору;

- трастовые сайты должны ссылаться только на трастовые сайты;

- если Ваш сайт будет ссылаться на ненадёжные сайты, то «минус в карму» будет записан как минимум Вам;

- околоссылочные тексты очень сильно влияют на передачу веса;

- ссылочный вес может передаваться даже без прямых ссылок. Т.е. есть сайт А, который ссылается на сайт Б, а сайт Б ссылается на сайт В. По такой схеме сайт В получает вес от сайтов А и Б.

Как защититься от фильтра «Социтирование»

Очень просто – никаких перелинковок (даже односторонних) с сомнительными сайтами (включая мошеннические, финансовые пирамиды, порно-сайты и т.д.). А если кто-то из таких ресурсов сослался на Вас – выше была оставлена ссылка на форму для подачи заявки на отклонение беклинков, пишите туда, пока не поздно.

Слишком много ссылок

Здесь речь идет о слишком активном наращивании ссылочной массы. Разумеется, если на Вас ссылается более 10000 доменов, то прирост по 100-200-300 ссылок в месяц считается нормой. Однако, если на Ваш сайт ссылается 10 доменов, то прирост по 100-200-300 ссылок в месяц однозначно наведет поисковую систему на подозрение о том, что ссылки куплены.

Выход прост: никаких резких скачков, только плавное и пропорциональное наращивание качественной ссылочной массы.

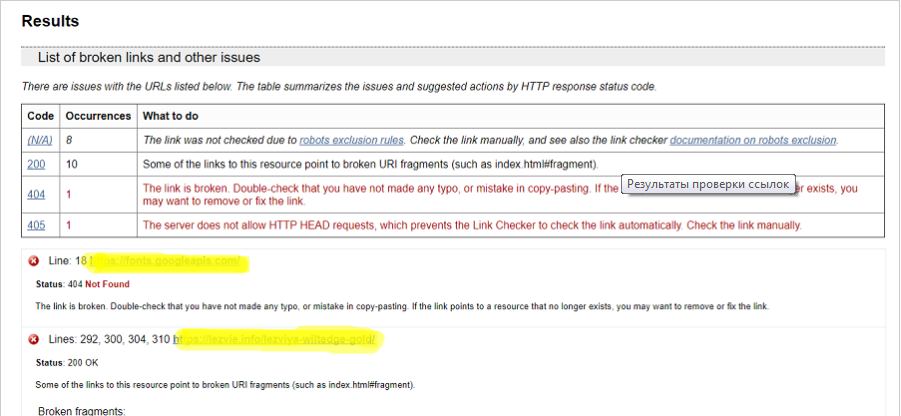

Фильтр за битые ссылки

Регулярно мониторьте свой сайт на предмет образования «битых» ссылок. Несмотря на то, что в Google уверяют, что битых ссылок может быть сколько угодно много, практика показывает, что за слишком большое количество битых ссылок сайт может быть пессимизирован.

Как защититься от фильтра за битые ссылки

Для мониторинга можно воспользоваться Link Checker’ом, либо программой Xenu. Битые ссылки необходимо либо исправлять, либо удалять.

Кстати, для сайтов на WordPress есть плагины, которые могут перекидывать пользователя с битых ссылок на «случайно попавшийся под руку» пост. Причем каждый раз пост будет разным.

Дублированный контент

Этот вопрос мы уже подробно рассмотрели в обсуждении алгоритма Панда. Еще раз – только уникальный и полезный контент, а если Вы скопировали контент с другого сайта, то не поленитесь и оставьте ссылку на источник.

Переоптимизация

По сути, этот фильтр является частью Панды. Он направлен на то, чтобы тексты оптимизировались не столько для поисковых роботов, сколько для людей. Причины наложения санкций:

- необоснованно чрезмерное употребление ключевых фраз в тексте;

- употребление ключевых фраз в тексте в том виде, в котором они были получены из, скажем, Яндекс.Wordstat (т.е. те самые нечитаемые «стиральные машины цена купить москва недорого доставка»);

- чрезмерное употребление ключей в Title, Description, атрибутах alt;

- выделение ключей жирным шрифтом.

Санкции сопровождаются снижением позиций и, как следствие, снижением посещаемости.

Как защититься от фильтра за переоптимизацию

Очень просто – перечитайте приведенный выше список и сделайте всё с точностью до наоборот. Т.е.:

- уберите лишние вхождения ключей;

- нечитабельные ключи разбавить другими словами;

- удалите повторяющиеся ключи в мета-тегах;

- уберите все выделения ключей в тексте.

Фильтр за медленную загрузку страниц

Тут все просто. Сайт должен грузиться быстро, т.к. это как минимум в интересах пользователей. Причины длительной загрузки могут быть следующими:

- долгий ответ сервера (претензии к хостинг-провайдеру);

- плохо оптимизированный код (т.е. из него нужно убрать все лишнее);

- огромное количество сопроводительных картинок/фотографий.

На последнем пункте остановимся чуть-чуть подробнее. В Рунете существует достаточно большое количество онлайн-сервисов, с помощью которых можно оптимизировать вес изображения (т.е. размер файла в килобайтах) с сохранением разрешения (т.е. размера файла в пикселях) и без потери качества картинки (или с минимальными потерями). С помощью таких сервисов вес изображения можно уменьшить на 40-60%, а в некоторых случаях – даже на 80%. Разумеется, можно внедрить на сайт функционал, который будет автоматически сжимать изображения, но суть дела от этого не меняется – именно передача картинок занимает больше всего времени, т.к. съедает больше всего трафика (вплоть до 99,999% от общего объема).

Еще раз – следите за тем, чтобы Ваш сайт ВСЕГДА загружал страницы быстро и без задержек. Задержки в загрузке страницы однозначно приведут к просадке позиций в мобильной выдаче (т.к. для мобильных устройств это куда более критично в силу более слабого железа), либо к просадке позиций как в мобильной, так и в основной поисковой выдаче. Ну и, естественно, под «просадкой позиций» автоматически подразумевается еще и просадка поискового трафика.

Фильтр за отсутствие оптимизации под мобильный трафик

Данный вопрос тоже уже затрагивался, поэтому еще раз:

- санкции накладываются ТОЛЬКО на мобильную выдачу;

- для Google допускается 3 пути вывода сайта из-под данных санкций – мобильная версия сайта, внедрение Google AMP (облегченных страниц), адаптивная вёрстка;

- для Яндекса допускаются те же 3 способа (только вместо Google AMP – Яндекс.Турбо-страницы – по сути, то же самое, только еще легче).

Также стоит отметить, что сейчас основным индексом является десктопный. Однако, количество мобильного поискового трафика уже настолько выросло, что скоро именно мобильный индекс станет основным. Поэтому ВСЕ САЙТЫ ДОЛЖНЫ БЫТЬ ОПТИМИЗИРОВАНЫ ДЛЯ МОБИЛЬНЫХ УСТРОЙСТВ!

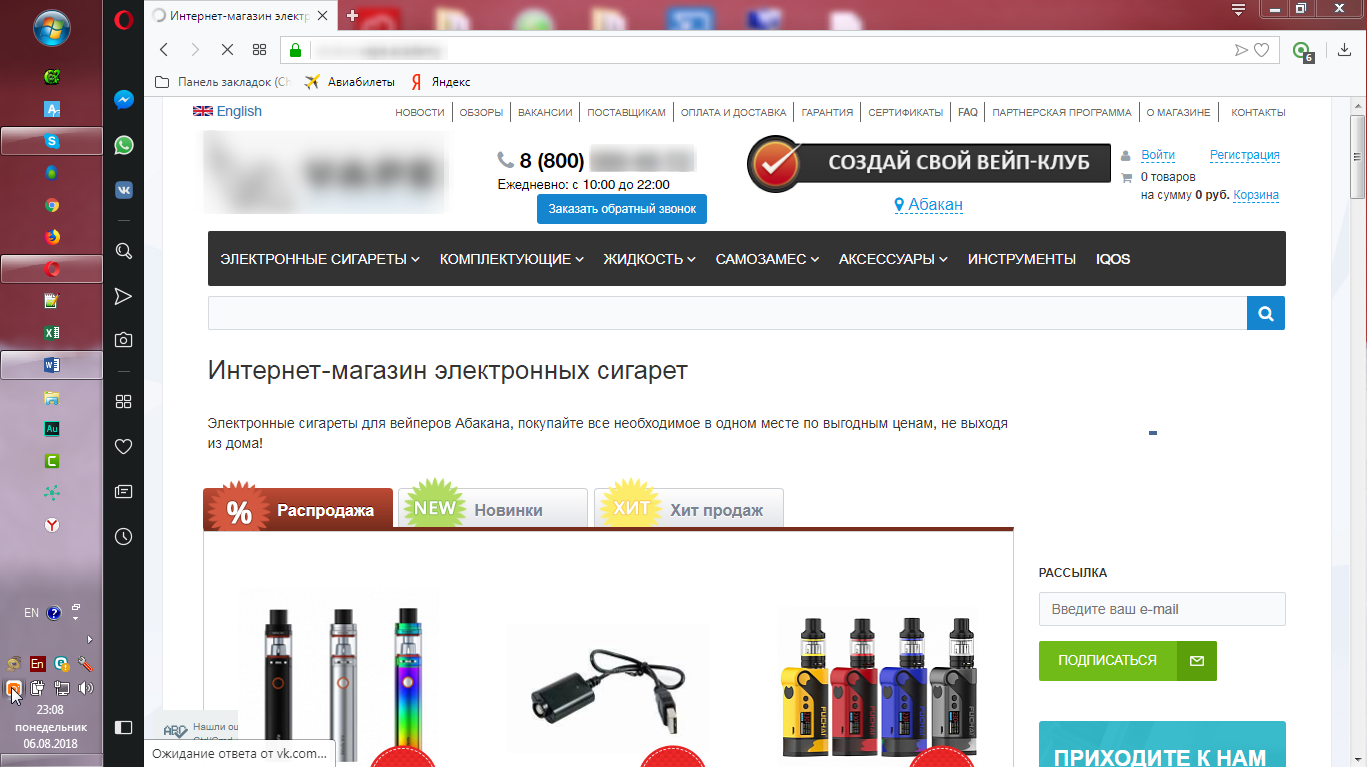

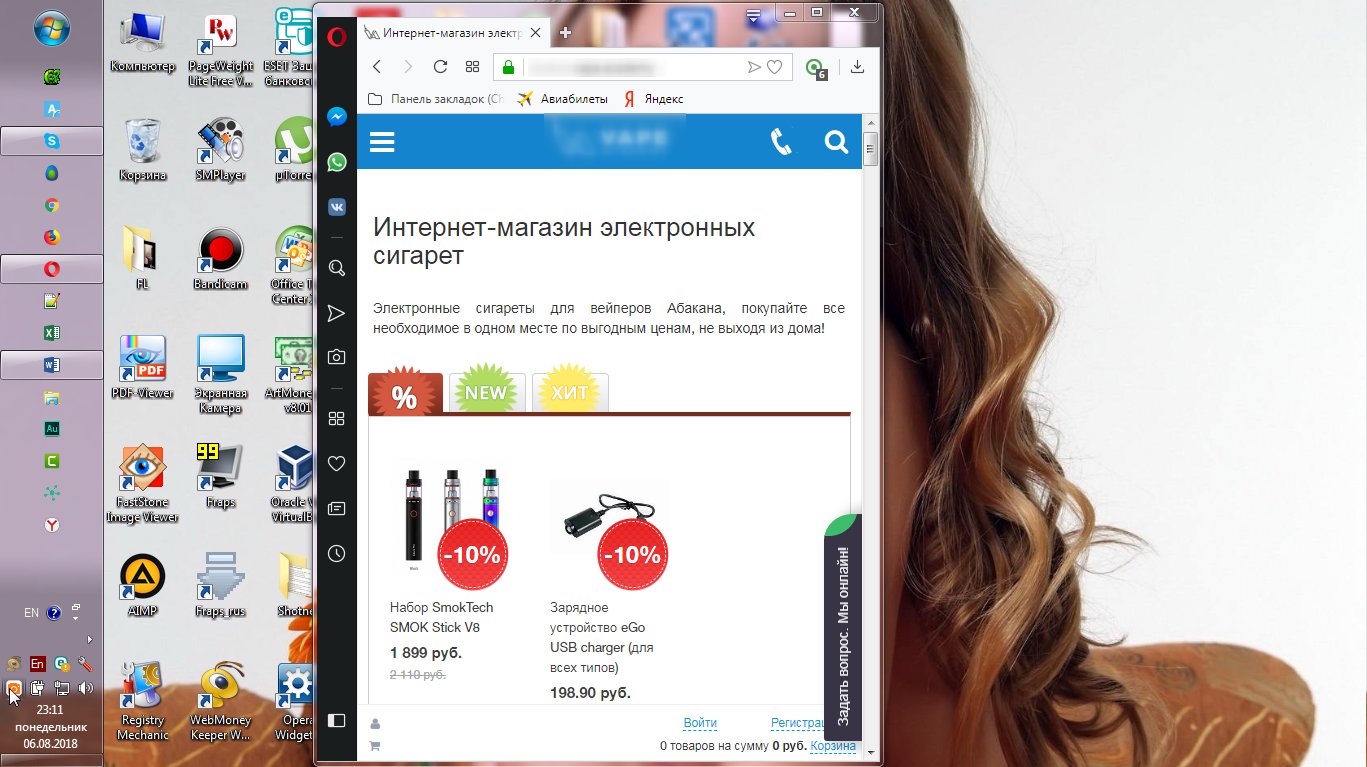

И отдельное слово про адаптивную вёрстку. Мы уже рассказывали о ней в одной из статей, расскажем еще раз. Ее фишка в том, что и на мобильные и на десктопные устройства грузится один и тот же html-код. Разница только в том, что страница сама решает, как именно ей отображаться. Проверить дизайн на адаптивность очень просто – достаточно вывести браузер из полноэкранного режима и искусственно уменьшить размеры его окна. Например, вот так выглядит сайт, когда браузер открыт в полноэкранном режиме:

теперь искусственно уменьшаем размеры окна и видим, что сайт отображается совсем иначе:

Обратите внимание – на втором скрине показан рабочий стол во весь размер, т.е. браузер тот же, сайт тот же, но с другим размером окна браузера отображается совсем иначе. Это и есть адаптивная вёрстка.

Санкции и фильтры «Яндекса»

Вот мы и до Яндекса добрались (не просто мы его упомянули в прошлом пункте). Фильтры Яндекса также имеет смысл рассматривать, поскольку данная поисковая система является самой популярной в России.

Основная фишка Яндекса в том, что с недавнего времени беклинки Яндекс перестал учитывать, ибо сознался, что бессилен в борьбе с закупкой ссылок. И это самое правильное решение, поскольку у 99,99999% сайтов, продвигаемых в Google, большинство ссылок является купленными. Выглядят они естественно или смахивают на спам – это уже другой вопрос. Но факт остается фактом – бороться с покупными ссылками реально бесполезно.

А вот за накрутки поведенческих факторов Яндекс карает жестоко и беспощадно.

1. АГС

Сам факт наличия фильтра АГС свидетельствует о том, что это «говносайт» - это почти официальный термин, ибо АГС дословно расшифровывается как АнтиГовноСайт. В историю фильтра углубляться не будем, просто скажем, что его основная суть заключается в том, чтобы подрезать позиции у тех сайтов, которые зарабатывают на манипуляциях поисковой выдачей, а именно:

- продажа SEO-ссылок, иногда даже открыто (т.е. ссылка закрепляется на текст вида «стиральная машина цена купить москва недорого доставка»);

- бесполезные тексты;

- украденные тексты без ссылки на источник;

- неудобный дизайн, хромающее юзабилити, технические ошибки;

- черные методы продвижения;

- агрессивная реклама.

Про черные методы продвижения рассказывать не будем, т.к. у нас на эту тему есть отдельная статья [закрепить ссылку https://stokrat.org/blog/dolbim-didzhital/metody-prodvizheniya-sayta-v-internete-v-2018-godu/], а вот на агрессивной рекламе остановимся чуть подробнее.

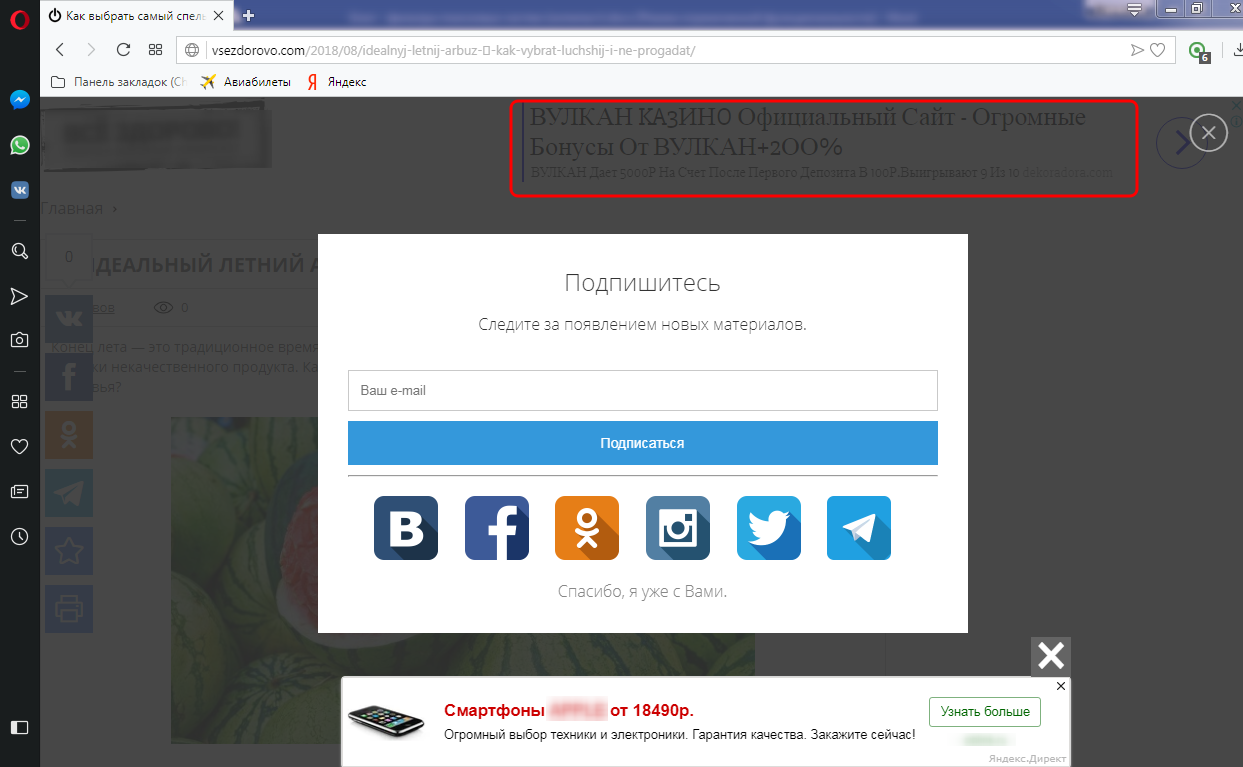

Увы, но на очень многих сайтах распространена такая практика – спустя 5 секунд с момента посещения Вам вылезает баннер на половину окна, на котором реклама какого-то сомнительного способа заработка. Что Вы делаете? Правильно – нажимаете на крестик, чтобы закрыть этот баннер. Но баннер, вместо того, чтобы закрыться, перебрасывает Вас на рекламируемый сайт. Вы плюётесь и закрываете оба сайта.

Также агрессивной рекламой считается чрезмерное количество рекламных блоков, которые мешают добраться до текста.

И вот Вам конкретный пример:

Во-первых, призыв подписаться – чем ТАКОЙ призыв лучше рекламы сомнительного заработка? Во-вторых, объявление о смартфонах. Оно «приклеено» к низу окна браузера, а если его закрыть – выскакивает другое объявление. И абзац делу трындец – реклама казино в шапке. Т.е. у данного сайта есть все шансы попасть под FUC-фильтр.

Признаки АГС:

- выпадение очень большого числа страниц из индекса;

- тИЦ = 0 (не всегда);

- замедленное индексирование новых страниц (либо новые страницы вообще не индексируются);

- за выпадением страниц резко снижается посещаемость из поиска.

Как вывести сайт после АГС

Очень просто – вычистить с сайта всё то, за что сайт попал под АГС:

- убрать с сайта все ранее проданные SEO-ссылки;

- исправьте все технические ошибки;

- допилите дизайн и юзабилити;

- склейте дубли;

- используйте канонические УРЛы;

- уберите всю агрессивную рекламу и навязчивые всплывающие окна;

- продумайте меню навигации;

- переработайте некачественный контент;

- к ворованному контенту оставьте dofollow-ссылки на источник;

- регулярно публикуйте новый качественный уникальный контент;

- когда всё будет исправлено, напишите в тех. поддержку Яндекса с просьбой снять санкции.

И самое главное – не удивляйтесь, если вывод сайта из-под АГС займет несколько месяцев – сами виноваты.

2. Алгоритм «Баден-Баден»

«Баден-Баден» (или, как его в шутку называют – Banned Banned) изначально задумывался как алгоритм, который будет пессимизировать сайты, злоупотребляющие ключевыми словами. Изначально так и было, про него даже выходили мемы наподобие вот этого:

Т.е. данный алгоритм в 2017 году наделал очень много шума. Первостепенная его задача заключалась в том, чтобы наказывать сайты, которые манипулируют поисковой выдачей путем напичкивания текстов различными ключевыми словами, которым страница не релевантна.

Однако, сейчас данный алгоритм работает немного иначе.

Во-первых, поисковые системы уже давно научились связывать слова в ключи даже тогда, когда одно слово находится в первом абзаце, а второе – в последнем, а между ними еще абзацев эдак… много. А это значит, что нет никакого смысла многократно употреблять в тексте ключи вида «стиральная машина цена купить москва недорого доставка». Более того:

- для того чтобы страница была релевантной в части «купить», всего лишь нужно, чтобы в карточке товара присутствовала кнопка «Купить»;

- для того чтобы страница была релевантной в части «москва», всего лишь нужно, чтобы в шапке сайта был указан московский адрес офиса (ну или пункта выдачи заказов);

- для того чтобы страница была релевантной в части «цена», достаточно просто указать цену.

Во-вторых, из сказанного выше можно сделать вывод, что дело не совсем в том, сколько раз употребляются отдельные слова «цена», «купить», «москва» и т.д. Дело еще и в том, соответствует ли размещенная на странице информация данным запросам.

Насчет цены. Да, мы не спорим, далеко не все ценовые запросы должны вести в карточку товаров. Например, на сайте такси или турагентства такое по определению невозможно, ибо там карточек товара нет вообще. Но это НЕ отменяет того, что цены нужно указывать. Т.е. никаких «цены приемлемые», «цены низкие», «цены высокие» быть не должно – только конкретика. Вспомните пример с пластиковыми окнами, который мы приводили ранее.

«До кучи» не грех вспомнить алгоритмы «Палех» и «Королев», которые как раз и затачивались на то, чтобы проверять соответствует ли текст поисковому запросу по смыслу или нет. Т.е. это «трио» делает оптимизацию текста с помощью многократных вхождений ключевых слов вообще пустой тратой времени.

Как защититься от «Баден-Бадена»

- переработать тексты таким образом, чтобы они стали полезными и легко читаемыми, старайтесь максимально подробно раскрыть тему;

- отказываться от употребления ключевых слов не стоит, «туры в турцию» можно употребить и в точном вхождении, т.к. ключ вполне нормально читается;

- крайне приветствуется синонимайзинг ключевых слов;

- не стесняйтесь разбавлять текст LSI-словами – по этой теме у нас целая статья [вставить ссылку на статью о LSI-запросах];

- знаете ли Вы, что такое «плотность ключей»? Если да – забудьте;

- знаете ли Вы, что такое «объем текста»? Если да – забудьте, ибо если для полного раскрытия темы требуется 6000 знаков – пусть столько и будет, 1000 – значит 1000, 25000 – значит 25000, сколько получится – столько пусть и получится (если не считать «воду»);

- не повторяйте одни и те же слова в мета-тегах (исключение – предлоги, союзы и т.п.);

- никаких выделений ключей жирным шрифтом.

3. Фильтр за накрутку поведенческих факторов

Чуть ранее мы уже говорили, что Яндекс полностью отказался от учета ссылочной массы, хотя Минусинск никто не отменял. Однако, взамен ужесточились санкции за манипуляцию поведенческими факторами.

Ну а теперь, собственно, о признаках наложения санкций:

- в Яндекс.Вебмастере появится соответствующее уведомление;

- резкая и очень крутая просадка позиций в Яндексе, вплоть до полной их потери;

- вместе с позициями просаживается и трафик;

- крайне медленное индексирование новых страниц (если они вообще индексируются).

Как вывести сайт из-под фильтра за накрутку поведенческих

Вы уже и сами догадались:

- перестать манипулировать выдачей;

- попросить прощения у Платона (т.е. написать в тех. поддержку);

- развивать сайт так, будто ничего и не было;

- терпеть, ибо ждать прощения придется долго.

4. Минусинск

Если в общих чертах, то АГС в каком-то смысле является аналогом Панды, а Минусинск – аналогом Пингвина.

Т.е. признаки попадания под Минусинск следующие:

- просадка позиций и, соответственно, трафика;

- отсутствие в ТОП-10 по витальным запросам.

Как вывести сайт из-под Минусинска

Методы те же самые, что и в случае с Пингвином, за исключением двух моментов:

- у Яндекса нет инструмента для отклонения беклинков;

- после того как ссылочный профиль будет очищен, потребуется написать в службу тех. поддержки Яндекса.

5. Фильтр аффилиатов

Многие предприниматели открывают несколько интернет-магазинов по продаже одних и тех же товаров. Расчет очень простой: если открывается 5 магазинов, то требуется всего лишь сделать так, чтобы все они заняли ТОП-10 по одним и тем же поисковым запросам. Аффилиат-фильтр как раз и необходим для того, чтобы ничего подобного в Рунете не было. Говоря простым языком, из 5 сайтов в ТОП попадет только один.

Вот несколько причин, по которым сайты могут быть признаны аффилиатами:

- полностью (или почти полностью) дублируется ассортимент;

- полностью совпадают цены (или имеют очень незначительные отличия);

- совпадает адрес организации;

- совпадает ИП и его ИНН;

- совпадают номера телефонов;

- совпадает хостинг-провайдер;

- совпадают IP-адреса сайтов;

и т.д. список можно продолжать долго.

Специально для тех, кто сейчас подумал «Что за?! Бред какой-то!» - Вы правы и не правы одновременно. Поясним. На одном и том же адресе действительно может быть несколько организаций. Например, магазин бытовой техники и продуктовый склад. Однако, больше совпадений у этих двух организаций нет. Если же совпадений больше – есть риск попасть под аффилиат-фильтр.

Более того, в нашей практике был кейс, когда 2 сайта были признаны Яндексом аффилиатами только за то, что их владельцы у одного и того же человека купили один и тот же плагин для реализации дополнительного функционала на сайте. Да, ассортимент товаров на сайтах тоже пересекался, но процентов на 40, не более, а цены не пересекались даже близко. Разумеется, все-таки удалось доказать, что наложение фильтра было ошибочным, однако, данный кейс наглядно показывает, насколько серьезно Яндекс подходит к данному вопросу.

В упомянутом выше кейсе признаки аффилиата выражались в том, что началась «чехорда» с позициями по ряду поисковых запросов – 2-3 дня в ТОП-10 находится один сайт, 2-3 дня – другой, причем на тех же позициях (плюс-минус одна-две позиции), потом снова первый, снова второй и т.д.

Как избавиться от фильтра аффилиатов

1) Необходимо закрыть все «дубли» Вашего интернет-магазина (если они действительно принадлежат Вам). Одной фирмы будет достаточно. Да, мы не спорим, если Вы в одном магазине продаете чисто смартфоны, а в другом – чисто отопительное оборудование, то 2 раздельных интернет-магазина, не смотря на совпадающие адреса и общего владельца – это будет самое правильное решение.

2) Если же Вы все-таки хотите захватить рынок с помощью нескольких интернет-магазинов, то делайте так, чтобы они максимально отличались друг от друга, вплоть до ассортимента, цен, дизайна, CMS, и даже юзабилити-фишек.

6. Санкции за взрослый контент

Тут всё просто – либо Вы публикуете контент категории 18+ (например, порно) и Вам на этот фильтр плевать, либо Вы публикуете всё, что к категории 18+ не относится. Фишка в том, что если сайт находится под данным фильтром, то он полностью лишается трафика по запросам, не имеющим отношение к 18+ материалам.

7. Пессимизация за отсутствие адаптации

Здесь будет достаточно упоминания о том, что данный фильтр в Яндексе вообще существует, ибо вопрос оптимизации сайта под мобильные гаджеты уже затрагивался в пункте «Фильтр за отсутствие оптимизации под мобильный трафик» про Google. С Яндексом ровно то же самое.

Чек-лист по фильтрам поисковых систем

|

Что сделано |

Санкции от Google |

Санкции от Яндекс |

Как вылечить |

|

Покупка ссылок, обмен ссылками, продажа ссылок |

Пингвин, иные ручные санкции. |

Минусинск, АГС |

Удалить купленные беклинки со сторонних сайтов. Отклонить беклинки через соответствующую форму Google (если не получается удалить). Прекратить торговлю ссылками. |

|

Публикация ворованного/отрерайченного контента |

Панда. |

АГС, дублирующиеся сниппеты. |

Удалить ворованный контент (или хотя бы указать первоисточник), переработать некачественный контент в качественный, публиковать только уникальные и качественные материалы. |

|

Сайт был создан для заработка на рекламе, а не для людей. |

Панда. |

АГС, агрессивная реклама. |

Сделать нормальный дизайн, исправить технические ошибки, доработать юзабилити, удалить агрессивную рекламу. |

|

Плачевное техническое состояние сайта. |

Панда, отсутствие оптимизации под мобильный трафик, фильтр за тормоза. |

АГС, фильтр за отсутствие оптимизации к мобильному трафику и некорректные мобильные редиректы. |

Исправить технические ошибки сайта, оптимизировать код, картинки, при необходимости – сменить тарифный план на хостинг или хостинг-провайдера. |

|

Злоупотребление ключевыми словами, бессмысленные тексты. |

Панда. |

Баден-Баден. |

Переработать тексты, сделав их полезными и легко читаемыми для людей. |

|

Накрутка поведенческих. |

Алгоритмические санкции. |

Фильтр за накрутку поведенческих. |

Прекратить накручивать поведенческие факторы |

|

Публикация материалов «для взрослых». |

Фильтр за соответствующий 18+ контент |

Удалить весь «взрослый» контент (исключение – если именно под контент 18+ сайт и создавался). |

|

|

Спам, клоакинг, иные «черные» методы продвижения |

Пингвин, Панда. |

АГС, Минусинск, иные санкции |

Прекратить мошенничать. |

|

Просто проблемы с трафиком, причины неизвестны |

Пингвин, Социтирование. |

Фильтр за накрутку поведенческих. Минусинск. |

Обратиться в службу тех. поддержки Google и Яндекса, мол, «меня атакуют конкуренты». |

|

Создано несколько сайтов с целью монополизации поисковой выдачи |

Аффилиат |

Ограничиться развитием одного сайта. Отдельные сайты имеет смысл создавать только в случае крайней необходимости для пользователей. |

|

Итак, в свете вышесказанного Вы уже и сами поняли, что большинство причин попадания под санкции кроются именно в Вашем поведении. Накрутили поведенческие – «получите, распишитесь». Написали бесполезные тексты – сами виноваты. Занимались купле-продажей/обменом ссылок – не обижайтесь.

Выводы

Итак, мы выяснили, что алгоритмы «Пингвин», «Баден-Баден», «Панда», АГС, «Минусинск» и т.д. созданы только с одной целью – очистить поисковую выдачу от того, чего там быть не должно. Именно поэтому в одной из статей мы гиперактивно призывали Вас НЕ использовать какие-то мутные схемы и черные методы продвижения. Более того, эти же алгоритмы обеспечивают Вам хоть какую-то, но все же защиту от проделок конкурентов, которые хотят выкинуть всех конкурентов из ТОПа, но при этом «топтаться на месте» в плане развития.

Плюс к этому, мы выяснили, что при желании можно вывести сайт практически из-под любых санкций – было бы желание и время. Ну и самое главное – сами поисковые системы зачастую САМИ Вам подсказывают, где и в чём Вы ошиблись, причем делают это абсолютно бесплатно, указав Вам правильный путь к победе.