СОДЕРЖАНИЕ

Зачем нужно вычислять траст сайта

Заключение или два слова про ИКС

Эпиграф: «Для начала ты должен понять главное – ложки не существует».

«Ложки не существует», впрочем, как и официального определения «траст» в словарях поисковых систем. Тем не менее, термин «траст сайта» в SEO-индустрии звучит достаточно часто. Поэтому давайте разбираться с тем, что такое «траст сайта», с чем его едят, чем закусывают, чем запивают, как вычисляют и т.д.

Что такое траст сайта

Еще в далеком-далеком 2004 году, когда деревья были зеленые, в воздухе летали птицы, а в морях и реках водилась рыба, поисковые системы работали по очень простым алгоритмам, которые в основном разрабатывались с расчетом на добросовестность вебмастеров. Примерно тогда и начали возникать низкокачественные (что еще важнее – молодые) сайты, цель которых была только одна – любой ценой привлечь как можно больше трафика – целевой, нецелевой, всё равно. Отсюда и пошли те самые «формулы счастья», когда в текст 1000 знаков запихивалось по 8-10 ключей, каждый из которых повторялся по 2-3, а то и по 4 раза. Как следствие – абсолютно бесполезный контент. Тем не менее, в то время это реально работало. И владельцы взрослых и реально качественных сайтов начали возмущаться – какого это рожна всякие желторотые щеглы ВОТ ТАК переманивают к себе кучу трафика, оставляя далеко позади тех, чей контент реально полезен?

Первой поисковой системой, которая взялась за очистку ТОП-10 от подобного мусора была Yahoo. Именно ее сотрудники впервые и употребили такой термин, как «траст сайта» (Trust Rank - уровень доверия). Фишка заключалась в том, что с возрастом сайта повышался и уровень доверия к нему. Естественно, новые сайты (поскольку они только-только были созданы) имели минимальный возраст, а потому не обладали таким же уровнем доверия, как взрослые проверенные временем сайты. Именно поэтому новым сайтам приходилось достаточно долго расти.

Примерно оттуда и пошел такой неофициальный термин, как «траст сайта». И несмотря на то, что официально данный термин у поисковых систем отсутствует, алгоритмы ранжирования сайтов затачиваются таким образом, чтобы в этом абстрактном термине укладывалось почти всё – качество текстов, возраст домена, ссылочная масса, поведенческие факторы и многое другое, что в той или иной мере повышает уровень доверия со стороны пользователей, а уровень доверия – это и есть тот самый траст, только уже со стороны поисковых систем. Однако, учитывая тот факт, что поисковые системы затачивают свои алгоритмы таким образом, чтобы ПОЛЬЗОВАТЕЛЬ получал быстро и своевременно ответы на интересующие его вопросы, можно смело уравнять понятия «траст со стороны поисковых систем» и «доверие со стороны пользователей».

Как рассчитывается траст

Поскольку нет официального определения – нет и официальных формул, по которым рассчитывается траст сайта. Следовательно, можно только принципиально догадываться, каким именно образом он оценивается. Если в общих чертах, то есть некие показатели/параметры, которые домножаются на коэффициенты, а полученные произведения суммируются. Т.е. выглядит формула примерно вот так:

Траст = k1*p1+k2*p2+…+kn*pn

Где, k – коэффициент, p – параметр.

Самое досадное, что точное количество параметров и размер коэффициентов неизвестен. Поэтому остается только одно – вычислять опытным путем, что именно влияет на траст сайта. Ну а теперь давайте разбираться, что именно вычислено опытным путем. Заранее предупреждаем, что прям на 100% верных данных в этой статье не будет.

Параметры, влияющие на траст.

Возраст проекта

Об этом говорится в достаточно большом количестве источников. Отчасти так и есть, т.к. после того, как поисковая система узнаёт о новом домене – она тут же накладывает своего рода «фильтр» на пару месяцев, давая тем самым возможность подготовить Ваш сайт к «выходу в свет». Что касается возраста домена в целом (т.е. уже после того, как фильтр будет снят) – тут нельзя дать однозначный ответ, т.к. зачастую сайты-новички ранжируются практически «на равных» с теми, у кого уже «стаж в несколько десятков лет».

Плюс к этому, многие разделяют такие понятия, как «возраст домена» и «дата первой индексации», поскольку сайт может достаточно большое время скрываться от индексации.

Качество сайта

Само понятие «качество сайта» весьма расплывчатое, поэтому дадим капельку конкретики.

Материал на сайте должен быть актуальным. Простейший пример – Яндекс отменил ТИЦ и ввел вместо него ИКС. Следовательно, абсолютно все статьи про ТИЦ утратили свою актуальность, поэтому их необходимо удалить с сайта, они больше не нужны. Если их оставить – пользователи могут быть введены в заблуждение, а это плохо.

Тексты должны быть уникальными, т.е. написанными самостоятельно, а не украденными с других сайтов.

Сам же контент должен быть полезен читателю. Т.е. если пользователь вводит запрос «как собрать табуретку» и попал на страницу Вашего сайта – значит там должен быть не просто ответ на этот вопрос, но и ответы на другие вопросы, которые по ходу чтения могут возникнуть у пользователя. Если Вы занимаетесь грузоперевозками – расскажите о том, что у Вас в штате есть грузчики, которые помогут с погрузкой-разгрузкой Ваших вещей, а также укажите стоимость оказания услуг.

Юзабилити, а если по-простому – удобство использования, т.е. сайт должен быть максимально функциональным и удобным в использовании. Если к сайту подключен онлайн-консультант, то окно не должно выезжать каждые 15 секунд со словами «Вы уже целых 5 секунд на сайте и еще ничего не купили? Давайте мы поможем Вам потратить Ваши деньги!». Если есть какие-то всплывающие окна – их лучше убрать, поскольку в 95% случаев они не вызывают ничего, кроме раздражения.

Микроразметка. Если коротко, это микрокорректировки кода сайта, позволяющие поисковым системам точно знать, что вот это – телефон Вашей организации, вот это – цена на конкретно этот товар, вот это – адрес и т.д., это тема для отдельной статьи.

Отсутствие дублирующегося контента на сайте – если он присутствует, то поисковая система может прийти в некое замешательство (как с тем ослом, который не может выбрать между двумя одинаковыми стогами сена). Дублирующийся контент необходимо либо закрыть от индексирования, либо склеить с помощью 301 редиректа (переадресации с одного адреса на другой). Самые распространенные виды дублирующегося контента:

- сайт одновременно работает как по http, так и по https-протоколам (решается 301 редиректом на https);

- сайт одновременно доступен как по site.xyz, так и по www.site.xyz (также решается 301 редиректа с одного адреса на другой, причем не важно с какого на какой);

- страницы доступны как по адресу site.xyz/page, так и по адресу site.xyz/page/ (и снова данная проблема решается 301 редиректом);

- архивы и метки (достаточно просто закрыть их от индексирования через robots.txt);

- дублирование карточки товара в другой раздел (такие дубли принято склеивать с помощью тега rel=”canonical”, прописав в нём адреса таким образом, чтобы первая страница ссылалась сама на себя, а вторая – на первую);

- «технические» дубли с динамическими адресами (закрываются от индексирования в robots.txt).

Вёрстка. Тут всё просто – она должна быть очищена от «мусора» и не должна содержать в себе ошибок.

Скорость загрузки. Чем быстрее грузится сайт – тем лучше. ВАЖНО!!! Поисковым системам абсолютно плевать, по каким причинам страница грузится дольше, чем положено. А причин может быть много – те же самые ошибки вёрстки, неоптимизированные изображения, подводит хостинг-провайдер и т.д.

Внутренняя перелинковка, т.е. размещение на странице ссылок на другие страницы. Качество внутренней перелинковки зависит от двух важнейших факторов:

1) анкор + околоанкорный текст + контекст, в котором дана ссылка + сама ссылка на страницу;

2) пользуются ли посетители этими ссылками.

Оптимизация мета-тегов. Если в двух словах, то заголовки Title и H1 должны крайне коротко, но точно описывать содержимое страницы, тег Description – это чуть более развернутое описание этой же страницы, а KeyWords должен содержать в себе ключевые слова, по которым продвигается страница. Многие мета-тегом KeyWords пренебрегают, поскольку Google на него не обращает вообще никакого внимания, а Яндекс обращается к нему крайне редко (если возникают какие-то «смутные сомнения»).

Входящие ссылки и их вид

Обратите внимание, что принцип «чем больше сайтов ссылаются на Ваш – тем лучше» уже давно не работает. Во-первых, Яндекс уже отказался от ссылочной массы как от фактора ранжирования. Во-вторых, у Google свои требования к ссылкам, причем очень жесткие:

- сайт-донор должен быть той же тематики;

- сайт-донор должен иметь высокий траст (т.е. по сути траст передается «по ссылочному наследству»);

- ссылка должна выглядеть естественно.

Одними из самых полезных ссылок являются ссылки с каталога Dmoz. Ранее сюда можно было отнести еще и Яндекс.Каталог, но… если у Вас новый сайт – забудьте про него, т.к. он уже закрыт для регистрации и в ближайшем будущем будет полностью ликвидирован.

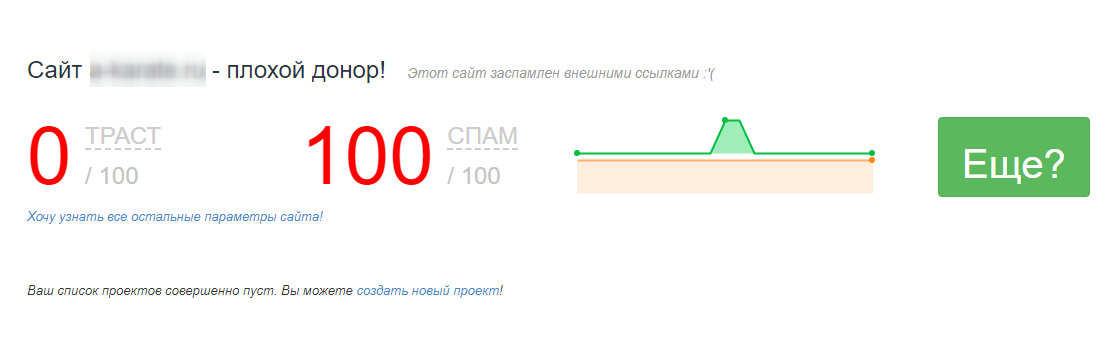

Отдельное слово хочется сказать про сайты, которые открыто торгуют ссылками. Если видите такой сайт – пройдите мимо и ищите другого донора. Как правило, ссылки с таких «доноров» либо не дают эффекта вообще, либо дают, но отрицательный. Да и сами такие «доноры» зачастую находятся под санкциями. Например, АГС, т.е. АнтиГовноСайт (мы не шутим, именно так оно и расшифровывается), либо аналогичные фильтры, наложенные за очевидную торговлю ссылками.

Исходящие ссылки

Если в двух словах, то здесь действуют примерно те же правила, что и в предыдущем пункте, за исключением одного важного момента – на этот раз донором будет выступать уже Ваш сайт. И если поисковые системы увидят, что Вы ссылаетесь на сайт, который под «ссылочными» санкциями, то с 90% вероятностью санкции будут наложены и на Ваш сайт.

Посещаемость и поведенческие факторы

Многие эти 2 фактора разделяют. Мы же предпочли их объединить в один, т.к. посещаемость – это и есть один из поведенческих факторов.

По канону считается, что самое большое количество трафика приходится на документ, который занимает 1 место в поисковой выдаче по запросу пользователя. Отчасти так и есть, однако, есть масса примеров, когда сайт находится на 8 позиции, но за счет позитивных поведенческих факторов потом подымается в ТОП-3 или даже в ТОП-1.

Теперь о том, какие поведенческие факторы считаются позитивными:

- если после попадания на Ваш сайт пользователь НЕ возвращается в поисковую выдачу, чтобы искать нужную ему информацию на других сайтах;

- если пользователь начал «гулять» по сайту;

- если пользователь долгое время находится на сайте;

- если пользователь лайкает/репостит/комментирует Ваши материалы;

и прочие сигналы, свидетельствующие о том, что пользователю данный сайт был полезен.

Негативными поведенческими факторами считаются:

- если после попадания на Ваш сайт пользователь ВОЗВРАЩАЕТСЯ в поисковую выдачу, чтобы искать нужную ему информацию на других сайтах;

- если спустя 2-3 секунды пользователь уходит с сайта;

и прочие сигналы, свидетельствующие о том, что пользователю Ваш сайт по каким-то причинам НЕ понравился.

Количество страниц

Данный фактор является несколько спорным, поскольку существует огромное количество ниш, в которых большое количество материалов вообще не требуется, поскольку «кому надо – тот знает, а кто не знает – тому и не надо».

Например, автосервисное оборудование – это ниша, в которой стоимость каждой единицы техники измеряется шестизначными, а то и семизначными ценами (если считать в рублях и не учитывать копейки). Т.е. если на сайте интернет-магазина автосервисного оборудования находится, скажем, 200 карточек товаров, то самый максимум, что можно сделать – заполнить их описаниями, добавить 200 страниц с подробными обзорами на все товары (или оформить как внутрикарточный переключатель), сделать еще около 50 страниц, в которых будут рассмотрены особенности той или иной линейки оборудования, а затем просто публиковать новости о том, что у такого-то производителя обновление ассортимента. Т.е. при самом шикарном раскладе это 500 страниц (ОК, пусть даже 600). И для многих эта цифра покажется впечатляющей, но… Если взять нишу бытовой техники, то там только карточек товаров может быть 10-12 тысяч. Так что количество страниц если и оказывает влияние на формирование траста сайта, то только в пределах тех ниш, где это уместно.

Зачем нужно вычислять траст сайта

Для вычисления траста сайта существует две основные причины. Во-первых, это своего рода «пузомерка», ибо не раз было замечено, что сайты с более высоким трастом ранжируются выше, несмотря на то, что у конкурентов контент качественнее. Во-вторых, чем выше траст сайта – тем больше будет пользы от размещения на нем ссылок на Ваш сайт (разумеется, если это сайты одной и той же, либо схожей тематики.

Отсюда следует пара выводов:

- чем выше траст сайта – тем легче продвигаться, чем ниже траст – тем тяжелее продвигать сайт;

- чем выше траст сайта – тем более крупную сумму Вы можете брать с желающих разместить ссылки на Вашем сайте.

Как узнать траст сайта онлайн

С причинами разобрались, теперь переходим к способам. По сути, способ только один – онлайн-сервисы. Их исследованием и займемся.

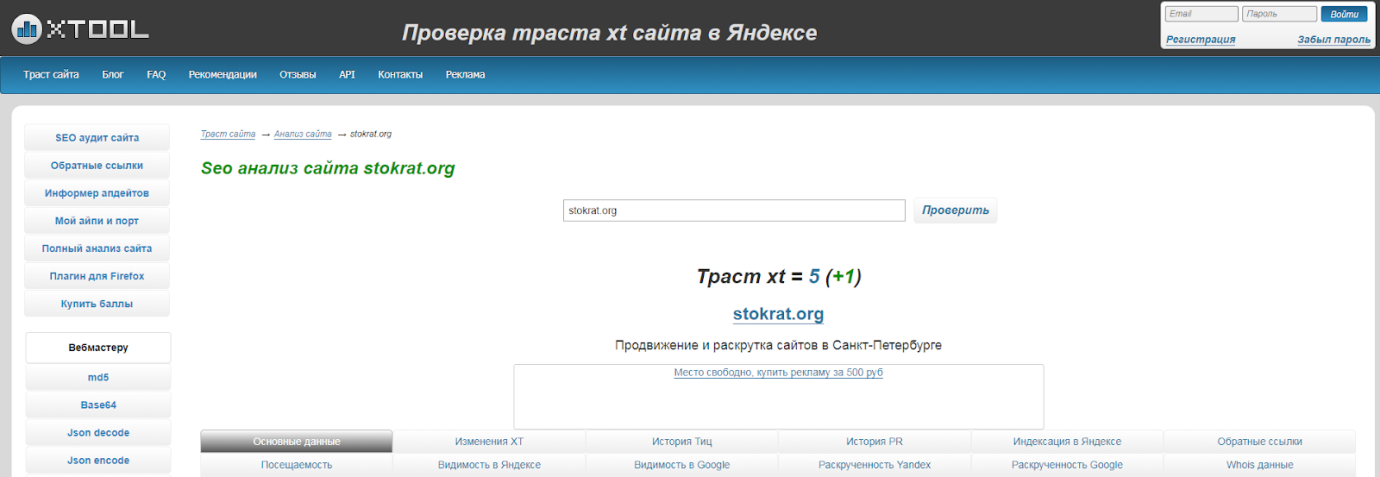

Xtool.ru

Данный сервис оценивает траст сайта от 0 до 10. В рамках данного сервиса данный показатель называется «Траст XT».

Если коротко, то 3 и менее – это слишком низкий уровень (т.е. с такими сайтами лучше не связываться), от 4 до 7 – это среднестатистические сайты (на них уже можно покупать ссылки), ну а 8-10 баллов – это вот прям «топчик», самые лакомые кусочки, с точки зрения донорства. Однако, есть и исключения, о которых мы расскажем чуть позже.

Работает сервис очень просто – указываем доменное имя в поле URL и нажимаем «Проверить».

На выходе Вы получаете ту самую оценку траста. В нашем случае мы видим, что траст вырос с 4 до 5 баллов.

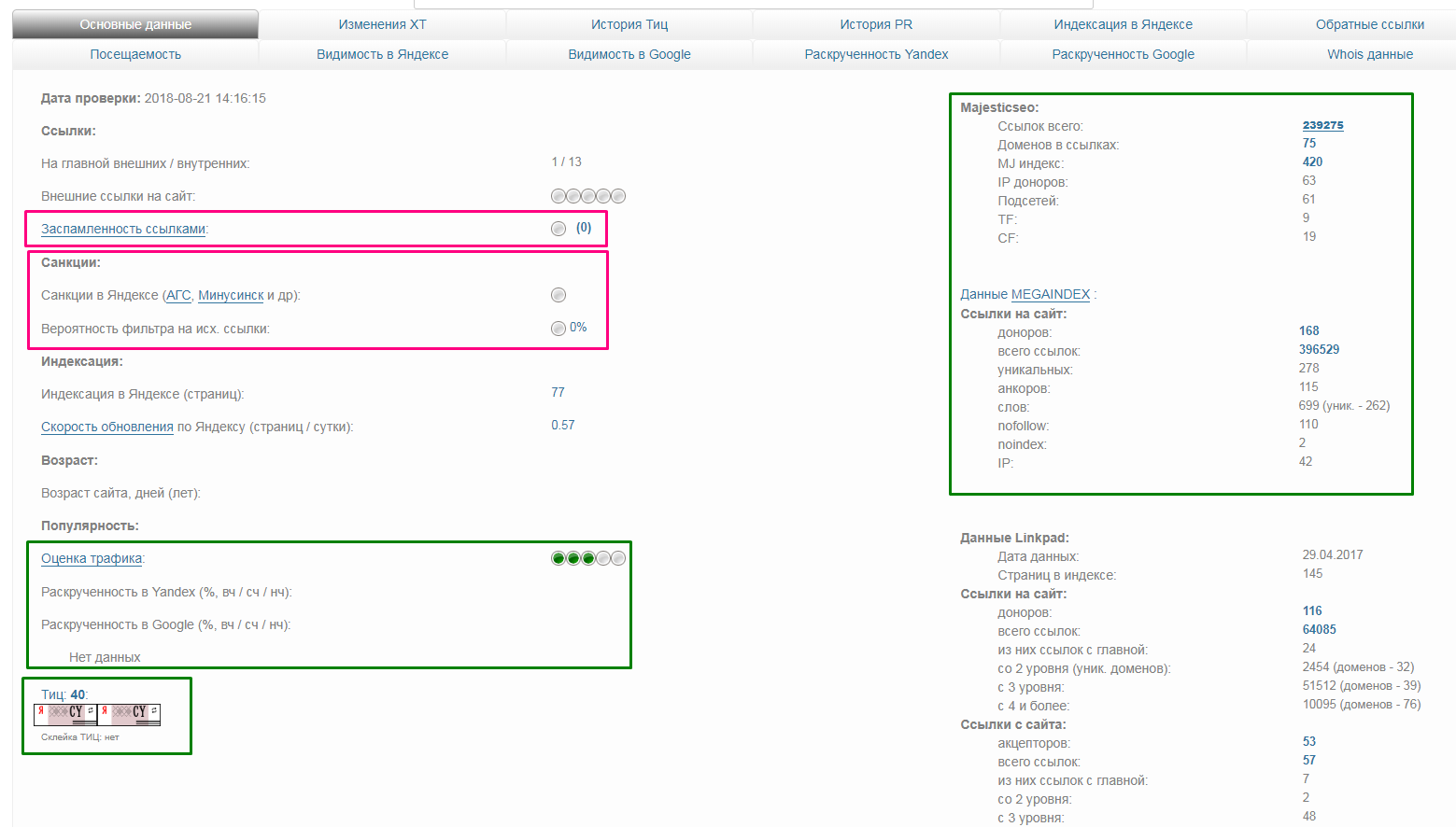

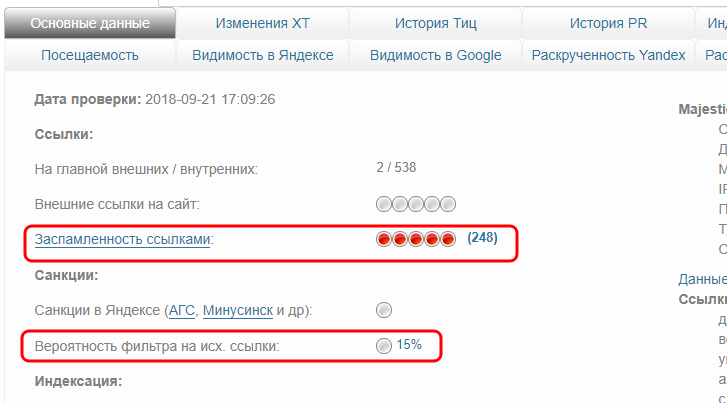

А теперь – самое интересное. Данный сервис показывает еще и некоторые критерии оценки. Ниже приведен скриншот, где розовым цветом выделено то, что негативно влияет на траст сайта, а зеленым – позитивно.

Как видите, среди негативных факторов присутствует ссылочная заспамленность (в данном случае – нулевая), а также наличие ссылочных санкций и примерная вероятность попадания под них (и то и другое отсутствует).

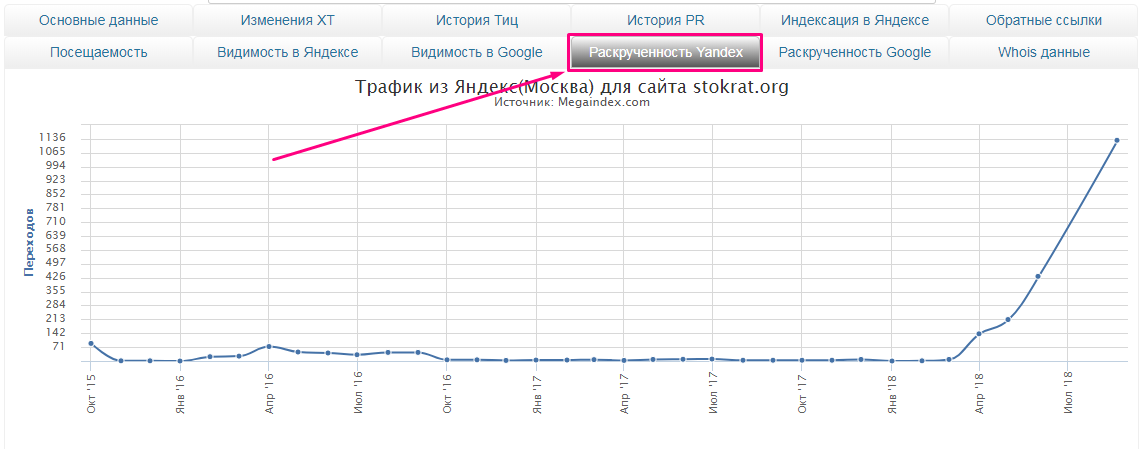

Но и это не всё. Сервис XTool позволяет в виде графиков глянуть:

- историю изменения траста сайта;

- историю тИЦ (хоть это уже и неактуально);

- историю PR;

- историю ссылающихся доменов на сайт по данным majesticseo.com и linkpad.ru;

- получить список обратных ссылок (https://xtool.ru/backlinks/);

- историю посещаемости сайта;

- запросы, по которым сайт лучше всего виден в поисковых системах Google и Яндекс;

Ну а теперь, как и обещали, расскажем про те самые сайты-исключения. Конкретные адреса приводить бессмысленно. Просто имейте в виду, что:

- если показатели скачут вверх-вниз – это нормально (например, 4-5-6-5-6-5-4-5-4-6 и т.д.), такой сайт вполне можно рассматривать в качестве ссылочного донора;

- если показатели за последние пару лет в целом падают, то такой сайт в качестве донора лучше не рассматривать.

И отдельное слово про список ключей, по которым сайт лучше всего виден в поисковых системах. Именно по этому списку можно определить, соответствует ли тематика потенциального донора тематике Вашего сайта.

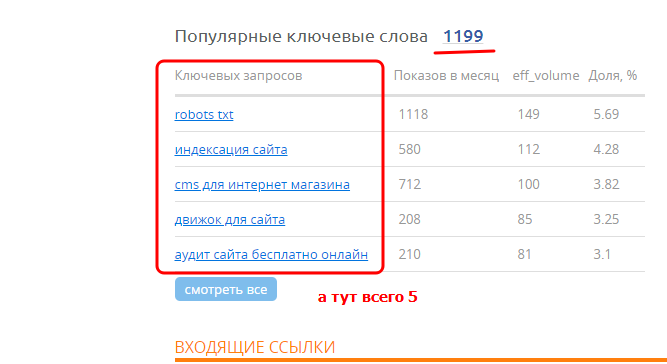

Например, вот такие показатели – это явный признак того, что сайт является слишком опасным донором для Вашего сайта:

MegaIndex (https://ru.megaindex.com/l/trust-saita)

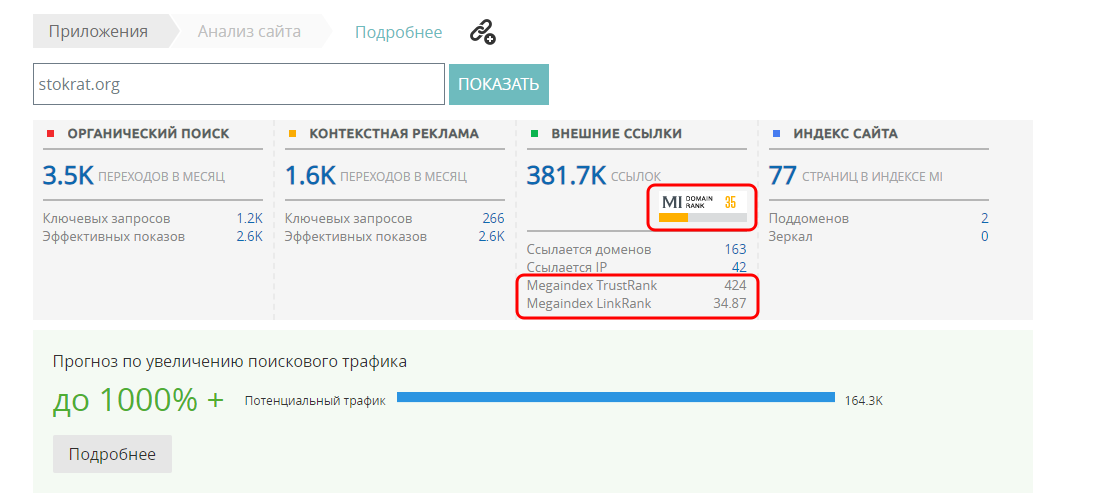

MegaIndex – не менее крутой сервис, чем XTool, поэтому он тоже заслуживает внимания. Запрос на домен делается ровно по той же схеме, только результат немного другой.

В данном случае, по мнению MegaIndex, траст равен 35 баллам из 100.

Помимо этого, Вы получите ряд исчерпывающей информации:

- график видимости сайта;

- график источников трафика сайта;

- из каких стран сайт привлекает трафик;

- список сайтов, откуда наибольшее количество переходов;

- типы обратных ссылок;

- доменные зоны, откуда идут ссылки на сайт;

- список ссылающихся сайтов (в платном режиме);

- список конкурентов сайта (в платном режиме);

- список запросов, по которым сайт лучше всего виден в поисковых системах (в платном режиме).

Насчет платного режима – это уже для более глубокого анализа, который для поиска доноров не требуется. К тому же эти списки можно просмотреть и бесплатно, но… скажем так – не полностью.

Однако, даже этих 5 ключей вполне достаточно для того, чтобы определить тематику сайта. Т.е. для оценки сайта в качестве донора ничего платить не потребуется.

CheckTrust

У этого сервиса мы рассмотрим сразу 2 полезнейших инструмента, 1 из которых Вы вряд ли найдёте где-нибудь еще.

1) Регистрируемся и логинимся на сайте https://checktrust.ru/, там можно проверить траст сайта аналогично предыдущим двум сервисам.

2) И, наконец, вишенка на торте - https://checktrust.ru/cabinet/market-control-center.html.

Здесь Вы можете скачать «черные списки» сайтов, торгующих ссылками на таких биржах, как:

|

Название биржи |

Количество сайтов в «черном списке»* |

|

Sape.ru |

784 |

|

Rotapost.ru |

26 |

|

Seohammer.ru |

413 |

|

Rookee.ru |

263 |

|

Webeffector.ru |

108 |

|

Gogetlinks.net |

47 |

|

Getgoodlinks.ru |

3 |

|

Seopult.ru |

98 |

|

Seopult.pro |

1432 |

|

Pr.sape.ru |

47 |

|

Megaindex.ru |

166 |

*данные актуальны на 21 сентября 2018 года

А? Ничего себе? Сервис CheckTrust просто так вот открыто предоставляет список сайтов, у которых никогда и не при каком раскладе нельзя покупать ссылки (исключение – если Вы хотите с помощью таких ссылок утопить сайт конкурента, но это далеко не всегда работает). Пожалуй, эта информация ценнее всей остальной статьи вместе взятой!

Как поднять траст

Для начала Вы должны усвоить главное – поднятие траста сайта НЕ должно быть Вашей основной целью. Траст – это всего лишь некая «пузомерка», отражающая, как в целом поисковые системы относятся к Вашему сайту. Ваша первостепенная задача – сделать сайт как можно лучше – чтобы контент был максимально полезным, функционал максимально богатым, дизайн – максимально удобным и комфортным, вёрстка – безошибочная, изображения и код сайта – оптимизированы для наибыстрейшей загрузки, а служебные страницы и дубли – закрытыми от индексирования, внутренняя перелинковка – уместной, а ссылочная масса – качественной и естественной. Т.е. просто делайте Ваш сайт как можно лучше, а вместе с повышением качества сайта будет повышаться и траст.

Самое главное – наберитесь терпения на несколько лет (или даже десятилетий), т.к. продвижение сайта – это очень непростая гонка, в которой есть старт, но нет финиша. Да, сойти с дистанции можно в любой момент, но это не отменяет отсутствия финиша.

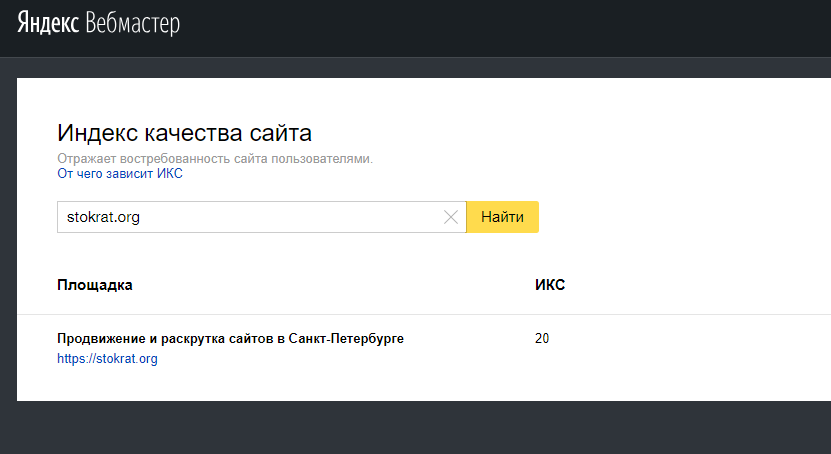

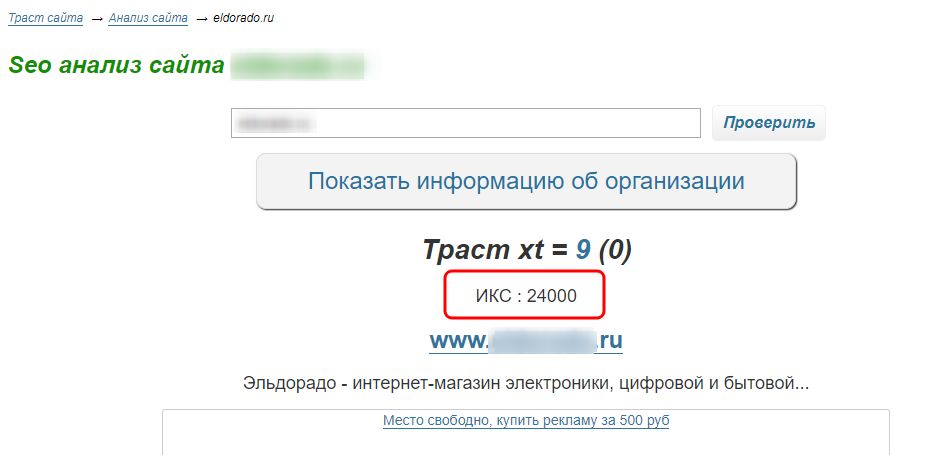

Заключение или два слова про ИКС

В самом начале мы сказали, что официально термина «траст сайта» не существует. Так-то оно так, но… В этой статье упоминался некий ИКС – Индекс Качества Сайта, данная «пузомерка» была запущена Яндексом совсем недавно. И пока что это единственная официальная «пузомерка», которая по смыслу наиболее приближена к понятию «траст сайта».

ИКС – это открытая «пузомерка», поэтому посмотреть ее можно на очень многих сервисах. Например, ранее упоминавшийся xtool.ru:

Также ИКС можно подсмотреть на официальном сервисе Яндекса - https://webmaster.yandex.ru/sqi/, для этого даже логиниться не придется.